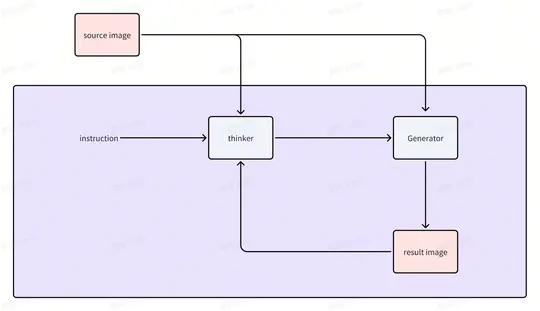

首先,用户提供了一张流程图,我需要分析这张图的结构和含义。图中包含几个关键组件:source image、instruction、thinker、Generator 和 result image,以及它们之间的箭头连接。

让我先拆解每个部分:

-

source image:这是一个粉红色的矩形框,位于图的顶部。它代表输入的原始图像,是整个流程的起点。

-

instruction:这是一个文字输入,指向

thinker模块。它表示对图像处理的指令或要求,比如“编辑图像”“生成变体”等。 -

thinker:这是一个灰色的矩形框,是流程的核心处理模块之一。它接收来自

instruction的指令,并且从箭头看,source image也有一个箭头指向thinker(图中source image到thinker的箭头是水平的,然后thinker到Generator也是水平的)。 -

Generator:这是另一个灰色的矩形框,位于

thinker的右侧。它可能是实际执行图像生成或编辑的模块,比如一个AI模型或算法。 -

result Image:这是一个粉红色的矩形框,位于图的底部。它代表流程的输出结果,即处理后的图像。

现在,分析箭头连接:

-

source image有两个流向:- 一个直接指向

thinker(水平箭头)。 - 另一个指向

Generator(图中source image到Generator的箭头是从上到下的,经过thinker后向下)。

- 一个直接指向

-

instruction指向thinker(左侧箭头)。 -

thinker指向Generator(水平向右箭头)。 -

Generator指向result Image(垂直向下箭头)。 -

此外,

result Image有一个箭头指回thinker(形成反馈循环)。

从整体流程看,数据流动是:

- 输入阶段:

source image(原始图像)和instruction(指令)是输入。 - 思考阶段:

thinker模块接收instruction和source image,进行处理或规划。这里可能涉及理解指令、分析图像内容等。 - 生成阶段:

Generator模块接收来自thinker的输出,并且可能也接收source image(因为source image有箭头到Generator),执行实际的图像生成或编辑任务。 - 输出阶段:

Generator的输出到result Image,即最终结果图像。 - 反馈机制:

result Image有一个箭头指回thinker,这表明存在一个反馈循环。可能用于迭代优化,比如thinker根据生成的result Image调整策略或指令,然后再次输入给Generator进行改进。

这个流程图描述了一个图像生成或编辑的迭代处理系统。类似于AI图像生成工具(如DALL·E、Stable Diffusion)的工作流程,但增加了“thinker”模块进行智能决策或规划。

具体应用场景可能包括:

- 图像编辑:根据指令修改源图像。

- 图像生成:基于源图像和指令创建新图像。

- 迭代优化:通过反馈循环不断提升生成质量。

关键点:

thinker模块是“决策大脑”,处理指令和初始输入,可能负责分解任务、规划步骤。Generator是“执行者”,实际生成图像。- 反馈循环(

result Image→thinker)允许系统自我改进,比如评估生成结果是否满足指令,若不满足则调整参数或策略。

用户的问题是“帮我分析一下这张图”,所以我需要清晰地解释流程、组件作用和潜在含义。

这张图展示了一个图像处理与生成的迭代工作流程,核心是通过“思考-生成-反馈”的循环机制,实现图像任务的智能化处理(如编辑、生成、优化)。下面我将从组件、流程逻辑、潜在应用和设计意图四个方面详细分析:

一、组件解析

图中元素可分为「输入层」「处理层」「输出层」,以及连接它们的箭头(表示数据/控制流):

| 组件 | 形态(颜色/位置) | 功能定位 |

|---|---|---|

source image | 粉色矩形(顶部) | 原始输入图像,是整个流程的数据起点 |

instruction | 文字标签(左侧) | 用户需求指令(如“把天空换成晚霞”“生成卡通风格头像”),是流程的任务起点 |

thinker | 灰色矩形(中部) | 核心“决策大脑”,负责解析指令、规划策略、迭代优化(比如理解需求、分析图像缺陷、调整生成参数) |

Generator | 灰色矩形(右部) | “执行者”,基于thinker的决策,实际生成/编辑图像(可类比AI图像生成模型、图像编辑算法) |

result image | 粉色矩形(底部) | 最终输出结果,是流程的数据终点 |

二、流程逻辑(数据流动与循环)

箭头方向定义了数据的传递路径,整体形成「输入→处理→生成→反馈→迭代」的闭环:

-

输入启动:

source image(原始图像)和instruction(任务指令)作为双输入,分别流向thinker。- 这一步模拟真实场景:用户既提供“要处理的素材”,也提出“要达成的目标”。

-

思考决策(thinker的核心作用):

thinker接收双输入后,完成两件事:- 解析

instruction:把模糊需求转化为可执行的“技术指令”(比如“把照片变油画风”→“提取风格特征+迁移渲染”)。 - 分析

source image:识别图像内容、结构、缺陷(比如原图光线不足、主体模糊)。

(此时thinker会生成“第一版执行策略”,传递给Generator。)

- 解析

-

生成执行(Generator的落地环节):

Generator接收thinker的策略,结合source image(图中source image也有箭头指向Generator,说明原始素材是生成的“基础参考”),执行图像生成/编辑操作,输出result image。 -

反馈迭代(闭环的关键):

result image并非终点——它通过箭头指回thinker,形成反馈循环。这一步的意义是:thinker评估result image是否满足instruction需求(比如“晚霞效果够不够浓?”“卡通风格是否失真?”)。- 若不满足,

thinker会调整策略(如修改参数、重新规划步骤),将新指令传给Generator,启动下一轮生成,直到结果达标。

三、潜在应用场景

这套流程的设计,天然适配需要**“智能决策+迭代优化”**的图像任务,典型场景包括:

- AI图像生成:如文生图(

instruction是文字描述,source image可空)、图生图(source image是参考图,instruction是风格/元素指令)。 - 图像编辑工具:如Photoshop插件、AI修图工具(

instruction是“去水印”“补全背景”,source image是原图)。 - 设计协作流程:设计师输入草图(

source image)和需求(instruction),系统自动生成多版方案(result image),再通过反馈迭代优化。

四、设计意图(为什么这样设计?)

这张图的架构暗藏两个核心逻辑:

- “思考”与“执行”分离:

thinker专注“智能决策”(理解需求、规划步骤),Generator专注“高效执行”(生成/编辑),避免“决策逻辑”干扰“执行效率”,也符合工程化中“分层解耦”的设计原则。 - 反馈闭环保障质量:图像任务常存在“主观性”(比如风格偏好、细节要求),单次生成难完美。通过

result image→thinker的反馈,系统能自主学习、迭代优化,更贴合人类“反复调整直到满意”的工作习惯。

如果结合当前AI技术趋势(如多模态大模型、图像生成扩散模型),这套流程可理解为:

thinker≈ 大语言模型(理解文字指令)+ 视觉大模型(分析图像内容),负责“智能规划”。Generator≈ 图像生成模型(如Stable Diffusion、DALL·E),负责“像素级执行”。- 反馈循环 ≈ 强化学习或自监督学习机制,让系统“越用越聪明”。

希望这个分析能帮你理解图中逻辑~如果是特定场景(如开发AI工具、学习图像算法),可以补充细节,我再针对性拆解! 🎨